Natürlich: Wenn wir über Künstliche Intelligenz sprechen, wird es komplexer. Da gibt es mehr Verzweigungen, mehr Schichten, die übereinandergelegt werden. Aber im Kern steckt genau dieses Prinzip dahinter. Aus diesem Grund, und da bin ich übrigens nicht allein, ist das, was heute unter dem Begriff I verstanden wird, für mich persönlich noch nicht das, was ich unter Intelligenz fassen würde. Was hat nun aber all das mit Machine Learning zu tun? Machine Learning ist ein Verfahren oder ein Ansatz, bei dem Computer Daten verarbeiten, also Informationen in algorithmischer Form durchrechnen und auf dieser Basis Muster erkennen oder Entscheidungen treffen.

Und hier noch einmal ein ganz zentraler Punkt, mit welchem ich auf mein Anliegen zurückkomme, Sie zu befähigen: Wenn wir Künstliche Intelligenz in der Sozialen Arbeit nutzen wollen, ist es aus meiner Sicht unerlässlich, dass Sie sich bereits im Entwicklungsprozess beteiligen. Denn um ein Machine-Learning-Verfahren zu programmieren und zu gestalten, braucht es Menschen. In diesem Fall sind das die Techniker*innen und Entwickler*innen, die die Parameter festlegen, die Entscheidungen treffen und die Gewichte setzen. Sie bestimmen also mit, wie ein Entscheidungsverlauf technisch umgesetzt wird. Ein Beispiel: Bei einer einfachen Ja-oderNein-Entscheidung kann ich einem bestimmten Ausgang ein Gewicht zuweisen, etwa in Prozent. Das bedeutet: Ich kann festlegen, welche Option unter bestimmten Bedingungen wahrscheinlicher ist. Und genau an diesem Punkt können wir als Fachkräfte Einfluss nehmen, weil diese Gewichtungen einen unmittelbaren Effekt auf das spätere Ergebnis haben. Deshalb gilt auch hier, dass KI von Menschen gemacht wird. Menschen beeinflussen, wie eine KI entsteht, wie sie entwickelt wird und letztlich auch, was sie kann. Je früher wir uns als Fachkräfte in diesen Prozess einbringen, desto besser wird das Ergebnis am Ende für unsere Klientinnen und Klienten. Insofern ist es ein wichtiger Impuls für die Soziale Arbeit zu beachten, dass es nicht darum geht, KI wie eine fertige Software einzukaufen, mit der man dann – ob sie nun passt oder nicht – irgendwie arbeiten muss. Wir kennen das alle: Man bekommt ein Tool und muss sich dann damit arrangieren, wie es eben ist. Bei KI aber haben wir die Chance, es anders zu machen. Wir können von Anfang an mitgestalten. Wir können sagen: Wir brauchen eine KI, die genau so funktioniert, weil... – und das ist möglich, weil die Programmierung von Menschen gemacht ist und damit auch gezielt von uns beeinflusst werden kann.

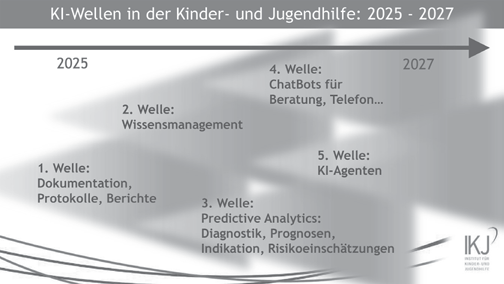

Machine Learning kennen Sie alle. Im Grunde genommen nutzen Sie das mit all den technischen Möglichkeiten, die heute ganz selbstverständlich dazugehören, tagtäglich, beispielsweise bei Spam-Filtern. Wenn man daran zurückdenkt, wie wir damals vor 20 Jahren gearbeitet haben, ist das eigentlich unvorstellbar: Heute haben wir alle unsere Laptops und Handys dabei. Und ich glaube, dass es mit der KI wahrscheinlich genauso laufen wird. In zehn Jahren werden wir vielleicht wieder hier sitzen, ganz anders diskutieren, ganz anders arbeiten und uns fragen: Warum waren wir damals eigentlich so unsicher? Warum hatten wir so ein Gefühl von Ohnmacht? Obwohl wir es heute ganz selbstverständlich nutzen. Von daher klingen diese Verfahren – also Machine Learning – erst mal wahnsinnig komplex. Und ja, aus technischer Sicht sind sie das auch. Aber wir müssen da gar nicht so tief einsteigen, um uns damit sinnvoll auseinanderzusetzen. Es reicht, wenn wir die grundlegenden Prinzipien dahinter verstehen.

Hier noch ein internationales Beispiel aus der Kinder- und Jugendhilfe im Pflegebereich. Es ist inzwischen schon ein bisschen älter, weil die Entwicklungen ja sehr schnell voranschreiten. Auch in diesem Bereich lernen Techniker*innen und Entwickler*innen natürlich mit jedem neuen Projekt dazu. Sie lernen besser einzuschätzen, wie sie die Parameter setzen müssen, damit die Ergebnisse verbessert werden. Im Beispiel wurde versucht, mit einem Machine-Learning-Verfahren eine Einschätzung vorzunehmen. Hierbei ging es um die Frage wie wir eigentlich vorhersehen oder einschätzen können, ob unsere Jugendlichen nach Verlassen der Pflege nicht plötzlich ganz allein dastehen. Wir alle kennen die Problematik rund um das Thema Careleaver – also junge Menschen, die nach dem Ende ihrer Zeit in der stationären Jugendhilfe keine Unterstützung mehr bekommen. Und erfahrungsgemäß sind das genau die, die auch danach noch den größten Unterstützungsbedarf hätten. Aus diesem Grund hat man sich gedacht, hier ein Machine-Learning-Verfahren auszuprobieren. Es wurde also versucht, Prognosen über vorhandene Daten zu erstellen. Hierfür wurden Datensätze aus 28 Jahren herangezogen, also ein riesiger Datenbestand. Diesen Bestand hat man mithilfe eines Algorithmus ausgewertet, der entsprechend danach programmiert wurde, solche Risikolagen zu erkennen. Das Ergebnis: Bei etwa 30 Prozent der Jugendlichen konnte ein hohes Risiko festgestellt werden. Das heißt, die Wahrscheinlichkeit war groß, dass sie nach Verlassen der Pflegeeinrichtung ohne jegliche Hilfe dastehen und damit potenziell gefährdet sind. Dazu muss man jedoch sagen, dass die Trefferquote mit 39 Prozent noch nicht wirklich überzeugend war. Da könnte man fast meinen, das ginge mit Raten genauso gut. Aber man muss auch sehen: Dieses Projekt wurde 2021 abgeschlossen - begonnen hat es 2018. Und seitdem hat sich die Technik natürlich weiterentwickelt. Wenn man heute ein solches Projekt starten würde, wären die Ergebnisse vermutlich deutlich besser. Das Beispiel zeigt, wofür man solche Machine-LearningVerfahren tatsächlich nutzen kann. Auf solche Ideen kommt man oft erst, wenn man sich ein wenig mit der Technik beschäftigt hat.

Das nächste Schlagwort, das man in diesem Zusammenhang oft hört, ist Deep Learning. Deep Learning ist ein Teilbereich von Machine Learning, das auf mehrschichtigen künstlichen neuronalen Netzen basiert. Alle DeepLearning-Methoden sind Machine Learning, aber nicht jedes Machine Learning ist Deep Learning. Und diese sind dann in der Lage, wie es so schön heißt, Muster in Datensätzen zu erkennen. Muster erkennen ist grundsätzlich etwas, was alle Algorithmen tun, der Unterschied bei Deep Learning ist, dass es hierarchische Merkmalsrepräsentationen automatisch lernt. Sie lernen innerhalb der vom Menschen vorgegebenen Trainingsdaten, Architekturen und Optimierungsprozesse und können also Generalisierungen finden, die nicht explizit programmiert wurden. Und genau da beginnt, so glaube ich, der Moment, in dem das Wort Intelligenz ins Spiel kommt. Denn ab dem Punkt, an dem eine Maschine aus Trainingsdaten gelernte Muster anwenden kann, ohne dass jedes Detail explizit programmiert wurde, nähern wir uns vielleicht einer Form von Intelligenz.

Aber wenn wir den Begriff lassisch betrachten, dann steckt da natürlich noch sehr viel mehr dahinter. DeepLearning-Verfahren können beispielsweise eingesetzt werden, um Textdaten wie Interviews oder Fallbesprechungen zu analysieren. Die KI kann dabei Muster erkennen, Informationen extrahieren und sogar Hinweise auf einzelne Klientinnen oder Klienten geben. Die dahinterstehende Idee ist, Ressourcen gezielter einzusetzen. Heute haben wir schon mehrfach gehört, dass durch KI alles effizienter wird und wir dadurch Zeit sparen. Ich persönlich bin da ehrlich gesagt nicht ganz überzeugt, darauf komme ich aber später noch einmal zurück. Die Frage ist, ob wir wirklich Zeit sparen, oder ob wir nicht einfach den Fokus verschieben. Vielleicht geht es eher in Richtung Qualitätsentwicklung durch den Einsatz solcher Verfahren. Denn auch wenn es auf den ersten Blick so scheint, als würde man eine Zeitersparnis erzielen, merkt man auf den zweiten Blick schnell: Da muss man doch einiges nachbearbeiten. Und ob das dann wirklich effizienter ist, da bin ich mir nicht so sicher.

Deep Learning wird im Kontext der Kinder- und Jugendhilfe als Verfahren mittlerweile international – in einigen Ländern tatsächlich schon in der Praxis – angewendet. Amerika ist hier der Vorreiter. Dort gibt es bereits große Landkreise, in denen KI-Systeme ganz selbstverständlich als Standard in Kinderschutzverfahren integriert sind. Der Algorithmus hilft dabei einzuschätzen, ob in einem konkreten Fall eine Gefährdung vorliegt oder nicht. Im Rahmen einer mehrjährigen Studie, die 2018 veröffentlicht wurde, hat man genau solche Verfahren ausprobiert. Und auch hier zeigt sich wieder: Die Entwicklung und der Einsatz von KI ist nichts, was einfach von selbst passiert. Es ist von Menschen gemacht. Die Daten, die in die Studie eingeflossen sind, wurden von Menschen erhoben, die dies ganz ähnlich auch in Ihrer Praxis täglich tun. Daten für Protokollzwecke, für Dokumentationszwecke oder für Abrechnungszwecke werden später auch in KI-Systeme eingespeist, um Algorithmen zu testen und zu trainieren. Hierbei hat man festgestellt, dass es tatsächlich zu Benachteiligungen kam. Einzelne Bevölkerungsgruppen wurden durch die KI auffällig häufig als Risiko eingestuft. Daraus wurde die wichtige Erkenntnis gewonnen, dass wir besonders vorsichtig sein müssen, wenn wir KI – und insbesondere Machine-Learning-Verfahren – in der sozialen Arbeit einsetzen. Denn hier spielt das berüchtigte Thema Bias – also die Verzerrung – eine zentrale Rolle. Die Verzerrung kann auf zwei Ebenen passieren: Zum einen auf der Ebene des Trainingsdatensatzes selbst. Ein Machine-Learning-Verfahren funktioniert ja nur, wenn man es zuvor mit Daten füttert, also trainiert. Oft kommen diese Trainingsdaten jedoch aus spezifischen Kontexten wie beispielsweise aus Universitäten, wo Studenten bestimmte Datensätze erheben, die dann gesammelt und verwendet werden, um die KI zu trainieren. Und erst, wenn die KI ein bestimmtes Niveau erreicht hat, wird sie auf reale Daten losgelassen.

Ganz oft sind das Datensätze, die die Diversität der Bevölkerung und ihrer Problemlagen nicht abbilden, sondern lediglich einen Ausschnitt darstellen, der allein deswegen bereits eine Verzerrung in sich trägt. Oft sehen wir beispielsweise bei KIs im Bereich Behinderung, dass diese all die unterschiedlichen Formen von Behinderung gar nicht abbilden, sondern Behinderung dann oft einfach verstanden wird als „da sitzt jemand im Rollstuhl“ – weil die KI schlicht nicht darauf trainiert wurde. Aber – und das werde ich später noch anhand unseres Projekts zeigen – die Verzerrung entsteht nicht nur in den Trainingsdaten der KI. Auch die Daten, die Sie täglich in Ihrer Praxis erheben, enthalten solche Verzerrungen, also Bias. Und genau diese Kombination aus voreingenommenen Trainingsdaten und verzerrten Anwendungsdaten führt oft zu Ergebnissen, die mit Vorsicht zu genießen sind. Da muss man sehr genau hinschauen, reflektieren und kritisch prüfen: Ist dieses Ergebnis wirklich diskriminierungsfrei? Oder verstärkt es vielleicht nur bestehende Sichtweisen oder Muster, die wir eigentlich insbesondere in der Sozialen Arbeit bewusst vermeiden wollen? Aus diesem Grund gibt es inzwischen viel Forschung zu der Frage, wie man KIs so trainieren kann, dass sie möglichst frei von Verzerrungen sind. Und natürlich: Wie wir in der Sozialen Arbeit solche KIs überhaupt sinnvoll und verantwortungsvoll einsetzen können. Auch wenn der Stand der Technik aktuell vielleicht noch nicht ganz ausreicht, arbeiten die Entwicklerinnen und Entwickler täglich daran und es sind bereits große Fortschritte gemacht worden. In den nächsten Jahren werden wir hier sicherlich noch deutlich mehr sehen. Denn es ist möglich, bereits bei der Programmierung gezielte Einstellungen vorzunehmen, um genau solche Verzerrungen zu vermeiden. Ein positives Beispiel für solche Einstellungsmechanismen finden Sie bei Chatbots wie ChatGPT oder ähnlichen Systemen. Dort ist es etwa so geregelt, dass bestimmte Themen wie Gewalt, sexueller Missbrauch, psychische Erkrankungen oder Suizid vom Chatbot nicht besprochen werden dürfen. Er wurde so programmiert, dass er in solchen Fällen nicht reagiert, das Gespräch verweigert oder ablenkt. Das ist ein Beispiel dafür, wie solche Schutzmechanismen sinnvoll eingesetzt werden können. Und genau solche Einstellungsoptionen gibt es nicht nur bei Sprachmodellen, sondern auch bei Machine-Learning-Verfahren insgesamt.

Jetzt zu unserem Projekt-Beispiel. Herr Hahn hat bereits angedeutet, wie es zu diesem Projekt kam. In diesem Fall war der Ablauf etwas anders, weil die KI bereits existierte. Sie war ursprünglich für die Industrie entwickelt worden. Ich hatte einen Vortrag der Entwickler gehört und gefragt, ob man das System nicht auch einmal in der Sozialen Arbeit testen könne und ob dabei wohl etwas Sinnvolles herauskäme. Nachdem die Antwort lautete „Wir wissen es nicht“, entstand schließlich das Projekt. Wir konnten drei Einrichtungen gewinnen, die sich beteiligt haben: das Haus Nazareth, eine weitere Einrichtung der Kinderund Jugendhilfe sowie eine Einrichtung der Sozialpsychiatrie. Unser Ansatz war es, den bestehenden Algorithmus auf Daten anzuwenden, die bereits im Arbeitsalltag von Fachkräften gesammelt worden waren. Auch hier ging es also nicht um speziell für diesen Zweck erhobene Daten, sondern um das, was ohnehin dokumentiert wurde. Wir haben den Algorithmus über diese Daten laufen lassen und anschließend mit jeder Einrichtung einen ganzen Projekttag durchgeführt. Dort wurde zunächst kurz der Algorithmus vorgestellt und darauffolgend dann die Ergebnisse präsentiert. Im Anschluss fanden Fokusgruppen statt, um die Ergebnisse gemeinsam aus sozialarbeiterischer Perspektive zu reflektieren. Während des Projekts sind auch ethische Bedenken aufgekommen, zu welchen es inzwischen auch einige Veröffentlichungen gibt. Nun aber zum Ablauf des Projekts: Die zentrale Fragestellung lautete im Grunde genommen, was die KI überhaupt aus den vorliegenden Daten erkennen kann. Kommen dabei sinnvolle Ergebnisse heraus? Und wenn ja: Lassen sich diese Ergebnisse für den Arbeitsalltag nutzen? Können sie also helfen, mit den vorhandenen Daten und dem Algorithmus tatsächlich relevante Erkenntnisse zu gewinnen?

Hierbei war besonders wichtig herauszufinden, ob der Algorithmus für die Soziale Arbeit geeignet ist, da dieser ja bereits existierte. Aus meiner Sicht macht ihn so interessant, dass er im Gegensatz zu vielen anderen KI-Systemen komplett annahmefrei arbeitet, also mathematisch gesehen ohne vorgegebene Hypothesen oder Annahmen auskommt. Das unterscheidet ihn von vielen gängigen Verfahren, die man sonst kennt.

Also, ich möchte Sie hier wirklich nicht mit Mathematik langweilen, aber normalerweise ist dieses BiasThema – ich habe es eben schon kurz erwähnt – Teil des Algorithmus. Denn dieser Algorithmus beruht auf Wahrscheinlichkeitsrechnungen. Die zugrundeliegende Mathematik folgt dem Prinzip: Was bisher immer so war, wird vermutlich auch in Zukunft so sein. Genau darauf basiert die Idee. Der Kollege, der diesen Algorithmus entwickelt hat, beschreibt es gerne so: Wenn man einen schwarzen Raben nach dem anderen vorbeifliegen sieht, geht man irgendwann davon aus, dass alle Raben schwarz sind – zumindest so lange, bis man plötzlich einen roten Raben sieht. In dem Moment stimmt die Rechnung sozusagen nicht mehr, und das zugrunde liegende Gesetz ist nicht mehr gültig. Genau das ist die mathematische Grundlage, auf der diese KI basiert. Und gerade deshalb finde ich sie für die Soziale Arbeit so spannend: Weil wir damit das Problem des Bias – also der Tatsache, dass in der KI oft schon eine Form von Diskriminierung enthalten ist – einfach einmal ausklammern können. Daher dachte ich, es wäre vielleicht eine interessante Variante, das einmal auszuprobieren.

Im Beispiel der Einrichtung mit EVAS hatten wir entsprechende Datensätze. Es gibt dort einen Aufnahmebogen, in dem eine Vielzahl an Informationen erfasst wird. Auf der linken Seite hatten wir zum Beispiel 362 Aufnahmebögen mit Rohdaten – und pro Klienten etwa 300 Merkmale. Wenn man das hochrechnet, kommt da schon eine beachtliche Datenmenge zusammen. Und das, obwohl der Betrachtungszeitraum der Fälle gar nicht so lang war – bei Euch, Daniel, waren es, glaube ich, etwa zwei Jahre. Zusätzlich hatten wir dann noch einen Verlaufsbogen.

Nach dem EVAS-System wird alle sechs Monate ein Verlaufsbogen erhoben, bei dem erneut verschiedene Merkmale erfasst werden – ebenfalls rund 300. Manche davon sind identisch mit denen aus dem Aufnahmebogen, aber natürlich nicht alle. Fachlich macht es ja auch Sinn, hier eine gewisse Unterscheidung zu treffen. Zusätzlich gibt es einen Abschlussbogen, der ausgefüllt wird, wenn der oder die Klient*in die Einrichtung verlässt. Wir haben uns alle Bögen angeschaut und kamen dadurch auf eine ziemlich große Anzahl – jeweils mit rund 300 Merkmalen pro Bogen, beim Abschlussbogen waren es sogar 350. Am Ende sieht das Ganze dann – anonymisiert – so aus: Man hat nur noch eine Art Tabelle vor sich, mit der man auf den ersten Blick kaum etwas anfangen kann. Aber genau das ist die Grundlage, mit der die KI arbeitet. Sie sehen: Man kann hier wirklich nicht mehr erkennen, um wen es sich handelt. Es sind nur noch Angaben wie das Erhebungsdatum, das Alter und bestimmte Merkmale – etwa der Symptomverlauf, die Entwicklung des jungen Menschen, der Abbruch oder Abschluss. Das sind alles Informationen, die in den verschiedenen Bögen erfasst wurden. Die KI wertet die Daten dann und erstellt anschließend Prognosen zu verschiedenen Zeitpunkten. Zum Beispiel direkt nach dem Aufnahmebogen eine Vorhersage über den möglichen weiteren Verlauf bis zum Abschluss. Oder auch zwischen zwei Verlaufsgesprächen eine Prognose darüber, was bis zum nächsten Verlaufsgespräch passieren könnte. Wichtig ist mir an dieser Stelle noch ein Punkt, der auch in den Gesprächen mit den Fachkräften immer wieder angesprochen wurde: Was verstehen wir eigentlich unter dem Begriff rognose? Eine Prognose ist keine Kristallkugel. Sie bedeutet nicht, dass etwas garantiert so eintritt. Eine Prognose heißt vielmehr: Wenn wir nichts ändern, ist es wahrscheinlich, dass dieses oder jenes Ereignis in Zukunft eintritt.

Die Grundidee hinter der Nutzung einer solchen KI ist: Wenn wir jetzt nichts verändern, wird der Verlauf voraussichtlich so weitergehen. Das bedeutet aber im Umkehrschluss auch: Wenn wir etwas verändern, wird sich auch der Verlauf wahrscheinlich ändern. Genau darin liegt der Reiz dieser Methode – mit Hilfe einer Prognose kann man gezielt Verhaltensweisen, Maßnahmen oder Interventionen anpassen, um zu verhindern, dass ein negativer Verlauf tatsächlich eintritt. Das ist im Kern der Gedanke dahinter: Warum nutzen wir überhaupt Prognostik in der Sozialen Arbeit? Eben, um frühzeitig Einfluss zu nehmen und Entwicklungen in eine bessere Richtung zu lenken.

Das hier ist ein Beispiel dafür, wie so etwas in der Praxis aussehen kann – ein ganz einfaches Beispiel zur Veranschaulichung. Wir hatten festgestellt: Das Thema Cannabis taucht offensichtlich häufiger auf. Und zwar schon bei der Aufnahme der Klient*innen, also direkt im ersten Bogen. Dort war der Punkt „Konsumintensität harter Drogen bei Aufnahme“ auffällig – und genau da hat die KI ein Muster erkannt. Ein Muster, auf das wir als Menschen wahrscheinlich nicht so direkt gekommen wären. Nämlich: Eine Auffälligkeit im Essverhalten bei der Aufnahme. Und zusätzlich: der Schweregrad der Gesamtauffälligkeit bei Aufnahme. Diese drei Parameter zusammen – also Cannabis-Konsum, Essverhalten und Gesamtauffälligkeit – hat die KI als ein wiederkehrendes Muster identifiziert. Immer wenn diese drei Merkmale gemeinsam auftreten, wurde ein negativer Verlauf prognostiziert. Das hat die KI also sozusagen als Muster herausgearbeitet. Und natürlich kann man dann versuchen, das irgendwie zu erklären – aber genau hier liegt der Knackpunkt: Es geht bei dieser Art von Analyse nicht um eine Kausalitätsbestimmung. Man kann also nicht sagen: Weil jemand Auffälligkeiten im Essverhalten zeigt, ist der Verlauf negativ. Oder: Weil Drogenkonsum vorliegt, passiert X oder Y. Sondern: Die KI erkennt einfach, dass dieses Muster immer wieder mit einem bestimmten Verlauf verknüpft war – Punkt. Keine weitere Interpretation, keine Erklärung im klassischen Sinn.

Und wenn wir uns das dann im Ergebnis anschauen – ich gehe jetzt nicht ins Detail, nur damit Sie es einmal gesehen haben – dann sieht das etwa so aus: Auf der rechten Seite erkennen Sie die blauen und roten Punkte, die größtenteils deckungsgleich übereinanderliegen.

Und genau hier sieht man, dass die Prognosewahrscheinlichkeit in diesem Fall sehr präzise ist. Denn die Linien – also das, was vermutet wurde, und das, was tatsächlich passiert ist – liegen nahezu deckungsgleich übereinander. Sie sehen hier zum Beispiel Abstufungen wie: kein Konsum, selten, weniger, öfter, kontrolliert, kontrolliert und abhängig – das sind Kategorien, die im Verlaufsbogen erfasst werden. Und genau in diesem Zusammenhang hat die KI ein bestimmtes Muster erkannt.

Was wir daraus ableiten können, ist: Die KI kann eine Vielzahl solcher Muster erkennen und sichtbar machen. Und wir können dann entscheiden, was wir damit anfangen. In unserem Fall haben wir mit einer Art Forschungsmaske gearbeitet – das war für die Fachkräfte in der Praxis zunächst etwas schwierig, weil es komplex und teils überfordernd war. Man müsste sich also im Vorfeld überlegen: Was wollen wir überhaupt wissen? Welche Prognosen sind für uns relevant? Welche Parameter sind für unsere Arbeit entscheidend? Am Beispiel des Cannabis-Konsums zeigt sich das gut: Wenn wir bereits bei der Aufnahme erkennen, dass dieses Thema relevant ist, und die KI daraus einen möglichen negativen Verlauf prognostiziert, dann können wir frühzeitig Maßnahmen ableiten. Zum Beispiel: Welche stationären Gruppen könnten hilfreich sein? Welche Fachkräfte sind hier besonders geeignet – etwa jemand mit Erfahrung oder Ausbildung im Bereich Sucht? Ziel ist es, mithilfe dieser frühen Hinweise den prognostizierten negativen Verlauf gar nicht erst eintreten zu lassen – indem wir gezielt gegensteuern. Wichtig dabei: Das ist natürlich nichts, was man einfach der KI überlässt. Und genau hier kommt wieder die menschliche Komponente ins Spiel. Die KI ist ein zusätzliches Tool – eine ergänzende Informationsquelle, die uns hilft, unsere Arbeit weiterzuentwickeln, anzupassen und zu verbessern.

Ich springe jetzt thematisch ein bisschen, weil die Zeit schon etwas knapp wird. Ein ganz wichtiger Punkt zur Prognostik ist noch: Sie bildet ausschließlich ab, was bisher passiert ist. Das bedeutet: Sobald eine Einrichtung ihre Maßnahmen verändert – etwa neues Personal einstellt, andere Interventionen plant oder die Gruppenzusammensetzung verändert – muss die Prognose neu berechnet werden. Das ist ein Umdenken im Vergleich zu früher. Früher hat man eine statistische Erhebung gemacht, und die war dann zumindest für ein paar Jahre gültig. Bei der Arbeit mit KI funktioniert das so nicht mehr. Hier braucht es ein System, das kontinuierlich im Hintergrund mitläuft – also ständig aktualisiert wird, damit es immer den aktuellen Stand der Dinge widerspiegelt. Nur so können die Veränderungen, die in der Einrichtung oder bei den Klient*innen stattfinden, auch wirklich in die Prognosen einfließen. Ohne dieses laufende „Retraining“ riskieren Modelle, dass sie veraltete Muster reproduzieren und die Praxis nicht optimal unterstützen. Es handelt sich also um eine Art laufende, automatisierte „Beobachtung“ bzw. Aktualisierung der Datenlage. Und genau das ermöglicht es uns: Wenn wir sehen, dass sich bei einem bestimmten Klienten oder einer bestimmten Klientin ein negativer Verlauf abzeichnet, können wir rechtzeitig eingreifen und gezielt etwas verändern.

Bei der zweiten Einrichtung war die Datengrundlage eine ganz andere. Dort wurde nicht mit EVAS gearbeitet – und wir haben ja gerade eben gehört, dass viele von Ihnen mit einem solchen System auch gar nicht arbeiten. Deshalb ist dieses Beispiel vielleicht besonders interessant. In dieser zweiten Einrichtung haben wir ausschließlich die Tagesdokumentation als Grundlage verwendet – also die ganz normale tägliche Dokumentation, wie sie ohnehin geführt wird. Die sieht zwar optisch ähnlich aus, aber das, was die KI daraus berechnet, unterscheidet sich natürlich deutlich. Denn hier beziehen sich die Prognosen nicht mehr auf bestimmte Verlaufsbogenphasen wie bei EVAS, sondern sie laufen auf täglicher Basis.

Und was wir dabei festgestellt haben, war wirklich spannend: In stationären Einrichtungen – etwa in der Kinder- und Jugendhilfe – lässt sich mit diesen Daten tatsächlich berechnen, wann in der Gruppe die nächste Krise auftreten wird. Und das lässt sich auf verschiedenen Zeitebenen prognostizieren: von Tag zu Tag, von Woche zu Woche oder sogar auf Monatssicht. Damit wird es möglich, Ressourcen vorausschauend zu planen und frühzeitig zu reagieren.

Ich höre schon, was sich hier gerade im Raum tut – dazu komme ich gleich. Vielleicht passt das auch ganz gut, denn diese Reaktion hatten wir auch in einem der Workshops: Da hat die Hälfte der Gruppe gesagt: Wenn ich jetzt schon weiß, wann die nächste Krise kommt – dann bleib ich einfach daheim!

Und damit sind wir bei der Frage: Was ist eigentlich eine Prognose? Eine Prognose bedeutet, dass wir sagen: Wenn wir nichts ändern, dann wird sich folgender Verlauf ergeben. Jetzt stellt sich natürlich die Frage: Müssen wirklich alle Fachkräfte solche Auswertungen sehen? Oder reicht es, wenn die Führungskräfte informiert sind? Die können dann beispielsweise den Schichtplan anpassen, dafür sorgen, dass genug und das richtige Personal da ist, damit eine Krise erst gar nicht auftritt. Genau deshalb machen wir solche Prognosen. Nicht, weil wir astrologisch in die Sterne schauen wollen, sondern um die Qualität der Betreuung und Begleitung zu verbessern. Für diesen Zweck sind Prognosen sicherlich sehr sinnvoll.

Die Implementierung jedoch muss gut durchdacht sein. Wie ich am Anfang schon gesagt habe: Das ist keine schnelle oder einfache Lösung. Es erfordert sorgfältige Prüfung und Überlegung, wann und wie solche Prognosen eingesetzt werden, wer daran beteiligt ist und wer die Ergebnisse sehen darf. Wir wollen auf keinen Fall Arbeitsbedingungen schaffen, die schwieriger sind als bisher. Gemeinsam mit Fach- und Leitungskräften haben wir mögliche Szenarien erarbeitet, wie und wofür man solche Prognosen nutzen kann. Sie sehen hier eine ganze Reihe von Optionen – und ich bin sicher, in der Praxis kommen noch viel mehr Ideen dazu.

Ein Thema, das in Zukunft sicher eine Rolle spielen wird, sind etwa Entgeltverhandlungen. Dabei könnte es sein, dass Geldgeber erwarten, dass solche Prognose-Tools eingesetzt werden, um nicht nur die Wirksamkeit zu prüfen, sondern auch die Qualität des Dienstes sicherzustellen. Nur zwei Beispiele herausgegriffen: Die gezielte Zuteilung von speziell ausgebildetem Personal zu bestimmten Gruppen von Klient*innen wäre eine interessante Möglichkeit. Momentan wird das oft eher nach Verfügbarkeit oder persönlichen Vorlieben geregelt. Mit Prognosen ließe sich das besser an den tatsächlichen Bedarf anpassen. Und zweitens könnten so gezielt Präventionsmaßnahmen angeboten werden, zum Beispiel, um zu verhindern, dass ein bereits bestehender leichter Drogenkonsum sich zu einem schwerwiegenden Problem entwickelt. Sie sehen, es gibt viele spannende Möglichkeiten und Fragen, die hier im Raum stehen.

Frage aus dem Publikum

Guten Morgen! Für mich stellt sich, da das Ganze ja auf sehr hohem wissenschaftlichem Niveau abläuft, die Frage: Gibt es für das eben von Ihnen beschriebene Vorgehen schon ein richtiges Tool oder eine Software, die wir nutzen können? Ich finde das Thema Diagnostik wirklich spannend, aber ich habe gehört, dass sich das alles noch im Evaluationsmodus befindet. Gibt es also bisher bereits eine fertige Software, ein Tool oder eine App, die man tatsächlich einsetzen kann?

Antwort

Prof. Dr. Christina Plafky

Ja, es gibt bereits eine Software bzw. ein Tool, aber dieses hat noch nicht die Marktreife erreicht. Wir befinden uns momentan – insbesondere im deutschsprachigen Raum – noch auf Prototyp-Niveau. Das bedeutet, wir testen und probieren Lösungen aus, um zu sehen, ob diese funktionieren oder nicht. Das Hauptproblem dabei ist die Finanzierung: Forschungsgelder fließen meist nur bis zur Prototypen-Entwicklung. Für die Überführung in die Praxis braucht es weitere Mittel, die aktuell oft fehlen. Anders sieht es aus, wenn eine Einrichtung solche Tools intern entwickelt. Dann sind sie oft besser auf die bereits genutzte Software abgestimmt und können direkt eingesetzt werden. Unser Projekt stammt von einer Hochschule, und das ist genau der Prozess, in dem wir uns gerade befinden.

Viele Einrichtungen entwickeln selbst Lösungen, aber das ist für kleine Organisationen oft kaum möglich, da sie weder über die technische Expertise noch über ausreichende Datenmengen verfügen. Für die Zukunft wird es nicht ausreichen, wenn jede Einrichtung ihre eigene KI entwickelt. Vielmehr wird eine Zusammenarbeit mit Hochschulen notwendig sein, weil diese die technische Entwicklung vorantreiben und Zugang zu größeren Datenmengen haben. International wird die Prognostik – wenn auch vielleicht nicht mit genau diesem Algorithmus – bereits eingesetzt und ist dort zum Teil schon marktreif. Im deutschsprachigen Raum stehen wir aber noch am Anfang.

Antwort

Daniel Hahn

Ein wichtiger Aspekt, den ich aus meiner Perspektive nochmal betonen möchte, ist die Praxis. Wir haben dieses Projekt durchgeführt und ich habe in meiner Rede betont, dass wir erst damit arbeiten können, wenn das Projekt wirklich reif ist. Aktuell hört man sehr viel über Prototypen, aber es ist wichtig zu wissen, dass es funktionierende KI-Tools gibt, die marktreif und nutzbar sind. Heute werden wir einige dieser Tools vorstellen. Es ist wichtig zu verstehen, dass das, was Sie hier hören, darauf abzielt, uns offen und neugierig zu halten und ermutigt, uns in den Diskurs einzumischen. Aber wie können Sie sich in den Diskurs einmischen? Eine Möglichkeit ist das Projekt KEPA, für das wir ein Folgeprojekt beantragt haben. Es war ein schwieriges Unterfangen, aber wir haben es geschafft. Das Projekt läuft jetzt für die nächsten anderthalb Jahre und ist zunächst auf Baden-Württemberg beschränkt. Es gibt jedoch auch andere Projekte, wie zum Beispiel das Projekt von Michael Macsenaere, über das er später noch sprechen wird.

Es ist wichtig zu verstehen, dass im Sozialwesen viele KI-Entwicklungen in Zukunft wie Pilze aus dem Boden schießen werden. Sie sollten nicht warten, bis ein Prototyp kein Prototyp mehr ist, sondern sich stattdessen in den Diskurs einmischen. Das Projekt KEPA bietet Kontakte und Möglichkeiten zur Informationsbeschaffung sowie zur Einbringung Ihrer Expertise. Sich in die Konzeption und Programmierung neuer KI-Tools in Ihrem Bereich einzumischen, ist ganz, ganz wichtig!

Antwort

Prof. Dr. Christina Plafky

Genau! Und um meinen vorherigen Punkt zu unterstreichen: Es geht hier nicht einfach darum, eine Software einzukaufen. Ich möchte noch einmal betonen, wie wichtig es für mich ist, dass Sie diese Informationen mitnehmen, damit Sie aktiv werden können, wenn ähnliche Entwicklungen stattfinden. Da gibt es noch eine offene Frage.

Frage aus dem Publikum

Guten Tag! Ich repräsentiere eine kleine heilpädagogische Einrichtung mit familiärer Ausrichtung, in der wir über 30 Jahre Erfahrung gesammelt haben – ein Aspekt, der auch im Kontext von Künstlicher Intelligenz (KI) relevant ist. Im Laufe unserer Geschichte haben wir uns sowohl mit der Milieutheorie als auch mit dem Metzler-Verfahren auseinandergesetzt, einem Ansatz, der versuchte, Jugendhilfe an handfeste Fähigkeiten wie Kochen oder Taschengeldverwaltung zu koppeln. Die Milieutheorie, oft von Jugendämtern genutzt, um die Rückfallquoten von Jugendlichen in ihre ursprünglichen Lebensumstände zu erklären, ist für uns besonders interessant. Es zeigt, wie wissenschaftliche Erkenntnisse sowohl positiv als auch negativ angewendet werden können – eine Lektion, die wir aus der täglichen Praxis ziehen. Ich bin überzeugt, dass KI nicht zum Werkzeug für solche einseitigen Ansätze werden sollte. Deshalb ist es wichtig, dass wir uns in die Entwicklung von KI einbringen.

Meine Beobachtung ist aber auch, dass der Algorithmus-Ansatz tendenziell dazu führt, Verantwortung weiter zu delegieren – weg von den Basisstrukturen, die direkt mit den Kindern arbeiten. Softwareentwickler und Jugendämter übernehmen diese Verantwortung oft unter fadenscheinigen Begründungen. Für mich ist es jedoch essenziell, dass die Verantwortung und Entscheidungshoheit bei denen verbleiben, die unmittelbar mit den Kindern interagieren. Ich bin seit über 30 Jahren in diesem Bereich tätig, weil ich fest an die Fähigkeit des Menschen glaube, sich grundlegend zu ändern – ein Aspekt, der für Algorithmen schwer zu erfassen ist. Ebenso wichtig ist mir, dass Pädagogen eine empathische Haltung haben, was in einer KI nur schwer abzubilden ist. Zu den Herausforderungen gehören auch Bindungsverhalten, Loyalität und Unvoreingenommenheit gegenüber Kindern und Klienten – Aspekte, die in einer KI-Kultur leicht verloren gehen. Und was macht es mit uns, wenn wir schon prognostisch wissen, in welche Richtung sich ein junger Mensch entwickeln wird? Auch das Lernen aus Fehlern ist tägliche Praxis für uns, aber ein schwieriger Punkt für KI-Systeme. Wie soll eine Maschine verzeihen oder Dinge wiedergutmachen, die ohne unser Zutun schiefgelaufen sind? Eine weitere Sorge ist die Haftung: Wer trägt die Verantwortung, wenn eine KI fehlt?

Ich erlebe zunehmend staatliche Interventionen im pädagogischen Bereich, die, wenn sie versagen, oft durch weitere Eingriffe ersetzt werden – ein Rückzug ist nicht vorgesehen. Dieses Muster ist für mich ein weiteres Defizit in der aktuellen Entwicklung. Ich danke Ihnen für Ihre Aufmerksamkeit und hoffe, mein Input trägt zum Diskurs bei.

Frage aus dem Publikum

Guten Tag! Ich komme aus dem VPK- Landesverband Baden-Württemberg und habe eine Frage an Herrn Hahn. Sie haben in Ihrer Anfangsrede sehr häufig von Moral und Ethik gesprochen. Sie kommen aus einem erzbischöflichen Kinderheim, und deshalb wäre es spannend zu erfahren, was passiert, wenn die Daten Ihrer Einrichtung mit denen von uns, als freie Vertreter der Jugendhilfe, kombiniert werden. Gibt es dann andere Ergebnisse – insbesondere im Hinblick auf Neutralität? Vielleicht können Sie auch erläutern, wie Sie bei Ihnen im Haus den Prozess unter moralischen und ethischen Gesichtspunkten definiert haben.

Antwort

Daniel Hahn

Ich gebe Ihnen zu 100 Prozent Recht – zum Glück gibt es Sie und auch alle anderen, die genau diese Fragen stellen. Das wünschen wir uns sehr. Sie haben völlig recht, wenn Sie sagen, dass KI nur begrenzt kann, was man ihr zutraut. Ich möchte ganz klar betonen: Ich bin kein Verfechter der KI. Ich sage nicht, dass KI die Lösung ist – ganz im Gegenteil. Man sollte sie eher als Hilfsmittel sehen, das möchte ich vorwegnehmen. Das ist mir sehr wichtig.

Christina Plafky hat es vorhin bereits gesagt: Algorithmen arbeiten mit Mustererkennung. Die spannende Frage ist, wie diese Muster überhaupt entstehen. Muster entstehen aus einem Blick in die Vergangenheit. Jede Entscheidung, die wir heute als Sozialpädagoginnen, Sozialpädagogen oder Sozialarbeiter treffen, basiert auf genau diesen Hintergründen, die Sie angesprochen haben. Zum Glück entstehen sie aus Beziehung, Bindung und manchmal auch aus persönlicher Enttäuschung. Vor der Hilfeplanung bringt jeder seine Erfahrungen mit ein – das beeinflusst die Entscheidungen – Stichwort Bias. Da spielt auch unser Bauchgefühl, unsere Emotionen mit rein. Fakt ist: Aus dem Hilfeplan entstehen Zielformulierungen und es werden Entscheidungen getroffen, die all diese Faktoren widerspiegeln. Diese Entscheidungen fließen in den Algorithmus ein. Die Frage ist: Welche Bestandteile sind darin enthalten? Nehmen wir als Beispiel 100 schwarze Raben, die vorbeifliegen. Wir haben schon immer mit allem, was wir sind, solche Entscheidungen getroffen – basierend auf diesen „100 schwarzen Raben“. Kommen jetzt ein oder zwei weiße Raben hinzu, stimmt das Gesetz nicht mehr. Wir müssen aufmerksam sein, uns neu justieren. Ich glaube, hier liegt die spannende Herausforderung: Wir müssen dem Algorithmus beibringen, nicht in der Vergangenheit zu verharren, sondern die Veränderungsprozesse, die Kinder, Jugendliche und wir selbst als Fachkräfte durchlaufen, auch für die Zukunft zu berücksichtigen. Ich wäre sehr an einer technischen Antwort darauf interessiert, weil ich das für eine große Gefahr halte. Wichtig ist mir auch zu sagen: Unsere jetzigen Entscheidungen werden schon jetzt mit solchen Algorithmen – und nicht nur bei KIEPA – verarbeitet und Muster daraus erkannt. Dann muss man sich fragen, wie diese Muster entstanden sind. Ich will nicht alle Probleme, die Sie aufgeworfen haben, kleinreden – die sind da und müssen diskutiert werden.

Zum Thema Ethik und Moral – insbesondere katholische Perspektiven – gibt es kein ausschließlich katholisches Evaluationssystem, worüber ich persönlich froh bin. Stattdessen nutzen wir ein konfessionsübergreifendes, konfessionsloses und hoffentlich sehr objektives Tool zur Wirksamkeitsmessung von Hilfen. Wir arbeiten mit EVAS, das ist jetzt ein beispielhaftes Tool. Wir versuchen, uns von konfessionellen oder ethisch-moralischen Narrativen – egal ob von der Kirche oder anderen Gruppen – möglichst zu lösen. Ob uns das immer gelingt, kann ich nicht sagen. Zum Prozess in unserer Einrichtung: Sie haben gefragt, wie das abläuft. Die Bögen werden nie allein ausgefüllt, sondern sind Teil eines institutionellen Prozesses im Team, mindestens im Vier-Augen-Prinzip. Und Gott sei Dank arbeiten bei uns nicht nur Katholiken in katholischen Einrichtungen. Es sind auch evangelische, muslimische und Menschen aller Glaubensrichtungen im Team. Diese Vielfalt fließt auch in die Skalierung ein, die keine Bewertung, sondern eine Einordnung darstellt.

Was ich allerdings nicht ausräumen kann, und das habe ich auch schon gesagt, ist: Wir müssen sehr genau darauf achten, von welcher Normvorstellung aus wir das Kind betrachten. Das ist ein wirklich wichtiger Punkt. Aber auch bei unseren Hilfe- und Erziehungsplänen gilt das schon: Nach welchen Kriterien skalieren wir? Wenn ich Sie fragen würde, welche Items wir abfragen, hätten Sie bestimmt viele Antworten. Die meisten Bögen enthalten vorgegebene Kategorien, wenige sind ganz frei formuliert. Orientierungshilfen brauchen wir, aber im Kern hat sich nicht viel geändert. Wir haben EVAS übersetzt, unseren Erziehungsplan angepasst und versuchen so objektiv wie möglich zu sein. Ich hoffe, ich habe Ihre Frage zumindest ansatzweise beantwortet. Sonst können wir gern später noch einmal darauf eingehen.

Antwort

Prof. Dr. Christina Plafky

Ganz kurz auch nochmal eine Antwort von mir: Es wurden hier schon einige Fragen angesprochen, die für uns der Grund sind, warum wir hier heute gemeinsam diskutieren. Auf viele dieser Fragen gibt es nämlich noch keine Antworten. Zum Beispiel auf die Frage der Entwicklung der Sozialen Arbeit in Bezug auf die oben gestellten Fragen. Oder auch die Frage, was das für unsere Fachlichkeit bedeutet. Oder: Wie verändert sich unser Blick, wenn wir KI-Empfehlungen hören? Das sind alles Themen, die wir selbst steuern müssen.

Es ist auch nicht so, dass KI einfach berechnen kann, was passiert – zumindest nicht in der Art, wie sie derzeit programmiert ist. Technisch kann man zwar Parameter setzen und bestimmen, was einbezogen oder ausgeschlossen wird, aber eine vollumfängliche Steuerung ist nicht möglich. Deshalb ist es wichtig, dass die Soziale Arbeit von Anfang an an der Entwicklung beteiligt ist, um diese Steuerung zu gewährleisten.

Worum es mir eigentlich geht: KI gibt immer nur eine Empfehlung – mehr nicht. Sie als Fachkraft können diese Empfehlung genauso ignorieren, wie Sie eine Empfehlung eines Kollegen oder Vorgesetzten ignorieren können. Wir müssen lernen, mit solchen Empfehlungen umzugehen. Darum betone ich auch, dass „Intelligenz“ in diesem Zusammenhang vielleicht das falsche Wort ist, weil es uns kleinmacht – dabei ist es nur eine Empfehlung. Genauso wie Sie von einem neuen Fachbuch beeinflusst werden, wird Ihr Blick auf die Klienten durch KI-Empfehlungen verschoben. Dem können wir uns nicht entziehen, aber wir können bewusst damit umgehen. Der springende Punkt ist, zu lernen, wann wir solche Empfehlungen nutzen wollen, wann nicht, wann sie ignoriert werden können oder wann sie hilfreich sind. Ich glaube, in den nächsten Jahren wird es vor allem darum gehen, diese Fragen nicht nur wissenschaftlich, sondern auch praktisch aus der Fachpraxis heraus zu bearbeiten.

Zum Thema Ethik: Ich habe in Fokusgruppen mit drei Einrichtungen gesprochen, zwei davon ohne konfessionellen Hintergrund. Alle haben ähnliche ethische Themen diskutiert – es gab keine Ausreißer, nur weil eine Einrichtung katholisch ist.

Und um noch einmal auf Ihre Aussage zurückzukommen: Es ist nicht so, dass die Fachpraxis vollkommen objektiv arbeitet. Die Praxis ist bereits subjektiv gefärbt, und das zeigt sich natürlich auch in den Ergebnissen der KI. Wie Sie gesagt haben, spiegeln sich darin die Haltung der Einrichtungen und die Basis der Daten wider. Als Beispiel: Eine Einrichtung hat sich nach einem halben Tag die Ergebnisse aus ihren Daten angeschaut und gesagt: „Sie verstehen das nicht, da taucht nur Krise auf, aber wir arbeiten doch ressourcenorientiert.“ Tatsächlich erfassen sie in ihren Daten fast nur Krisen – negative Ereignisse und Fehlentwicklungen. Positives wird kaum aufgenommen. An diesem Punkt kann KI als wirkungsvoller Spiegel dienen, um die eigene Praxis zu reflektieren. Und noch einmal zurück zu den Trainingsdaten und dem sogenannten Bias. Es ist nicht die KI selbst, die ein Bias hat, sondern wir, weil wir bestimmte Verhaltensweisen zeigen und bestimmte Daten sammeln, die Muster erzeugen. Die KI holt diese Muster nur an die Oberfläche. Wenn man das so sieht, gewinnt man automatisch mehr Handlungsmacht zurück und ist dem Ganzen nicht hilflos ausgeliefert. Das möchte ich zur Ethik-Frage noch ergänzen.

Um es kurz zusammenzufassen: Meine Erkenntnis aus dem Projekt ist, dass jede Einrichtung ihre Datensammlungspraxis überprüfen muss. Haben wir in unserer Datensammlung vielleicht ein Bias? Arbeiten wir wirklich nach den Haltungen und Prinzipien, die wir uns vornehmen oder in unseren Leitlinien festgeschrieben haben? Es braucht definitiv noch viele Forschungsprojekte und Überprüfungen, wie wir damit gut umgehen können. Das findet sich auch in der Literatur wieder, etwa als Idee einer Art Betriebserlaubnis für KI. Man kann nicht einfach eine KI kaufen und erwarten, dass sie funktioniert wie Word. So funktioniert das nicht. Man muss sich vorher mit diesen Themen auseinandersetzen. Deshalb braucht es künftig gerade in der Sozialen Arbeit eine Art Betriebserlaubnis für den Einsatz von KI. Und vor allem brauchen wir Sie als kritische Nutzerinnen und Nutzer, die die Ergebnisse verstehen und verantwortungsvoll in der Praxis umsetzen. An dieser Stelle gebe ich nun an meinen Kollegen weiter.